Chân dung CEO Anthropic Dario Amodei

Chân dung CEO Anthropic Dario Amodei

Nhà lãnh đạo thẳng thắn nhất của ngành AI đã tìm thấy định hướng từ một bi kịch cá nhân.

**Dario Amodei không **ngần ngại khi tôi hỏi điều gì đã thôi thúc ông. Vị CEO của Anthropic đã trải qua năm 2025 trong một cuộc chiến, đối đầu với các đối tác trong ngành, các thành viên chính phủ và cả nhận thức của công chúng về trí tuệ nhân tạo.

Trong những tháng gần đây, ông đã dự đoán rằng AI có thể sớm loại bỏ 50% công việc văn phòng cấp thấp. Ông đã chỉ trích gay gắt lệnh cấm điều tiết AI trong mười năm trên tờ New York Times. Và ông đã kêu gọi kiểm soát xuất khẩu chất bán dẫn sang Trung Quốc, dẫn đến sự phản bác công khai từ CEO Nvidia, Jensen Huang.

Giữa tất cả những điều đó, Amodei gặp tôi ở tầng một của trụ sở công ty tại trung tâm San Francisco. Ông thoải mái, năng nổ và háo hức bắt đầu, như thể ông đã chờ đợi khoảnh khắc này để giải thích về hành động của mình. Mặc một chiếc áo len cổ sam màu xanh bên ngoài áo phông trắng đơn giản và đeo cặp kính gọng dày hình hộp, ông ngồi xuống và nhìn thẳng về phía trước.

Amodei nói rằng, nền tảng cho những nỗ lực của ông là niềm tin vững chắc rằng AI đang tiến bộ nhanh hơn hầu hết chúng ta nhận thấy, khiến cho các cơ hội và hậu quả của nó gần hơn nhiều so với vẻ ngoài. “Tôi thực sự là một trong những người lạc quan nhất về việc khả năng của AI sẽ cải thiện rất nhanh,” ông nói với tôi. “Khi chúng ta tiến gần hơn đến các hệ thống AI mạnh mẽ hơn, tôi muốn nói những điều đó một cách mạnh mẽ hơn, công khai hơn, để làm rõ quan điểm.”

Sự thẳng thắn và những va chạm sắc bén của Amodei đã mang lại cho ông cả sự tôn trọng và chế giễu ở Thung lũng Silicon. Một số người xem ông là một nhà lãnh đạo có tầm nhìn công nghệ, người đã tiên phong trong dự án GPT-3 của OpenAI (tiền thân của ChatGPT) và là một nhà lãnh đạo quan tâm đến an toàn, người đã tách ra và thành lập Anthropic. Những người khác lại xem ông là một “kẻ bi quan” (doomer) muốn kiểm soát, làm chậm tiến trình AI, định hình nó theo ý mình và loại bỏ đối thủ cạnh tranh.

Dù yêu hay ghét, lĩnh vực AI sẽ phải đối mặt với ông. Amodei đã biến Anthropic, hiện được định giá 61 tỷ USD, thành một thế lực kinh tế. Từ con số không vào năm 2021, công ty — dù vẫn chưa có lãi — đã tăng doanh thu định kỳ hàng năm từ 1,4 tỷ USD vào tháng 3 năm 2025 lên 3 tỷ USD vào tháng 5 và gần 4,5 tỷ USD vào tháng 7, khiến Amodei gọi đây là “công ty phần mềm phát triển nhanh nhất trong lịch sử ở quy mô hiện tại.”

Có lẽ điều đáng chú ý hơn cả doanh thu của Anthropic là cách nó được tạo ra. Thay vì chủ yếu dựa vào các ứng dụng như ChatGPT của OpenAI, canh bạc lớn nhất của Amodei là vào chính công nghệ nền tảng. Amodei nói với tôi rằng, phần lớn doanh thu của công ty đến từ API của họ, hoặc thông qua việc các công ty khác mua mô hình AI của Anthropic và sử dụng chúng trong sản phẩm của riêng họ. Do đó, Anthropic sẽ là một thước đo cho sự tiến bộ của AI, thăng trầm dựa trên sức mạnh của công nghệ.

Khi Anthropic phát triển, Amodei hy vọng sức nặng của nó sẽ giúp ông ảnh hưởng đến hướng đi của ngành. Và với sự sẵn lòng lên tiếng, tung một cú đấm và nhận lại một cú, ông có lẽ đã đúng.

Vì vậy, nếu người đàn ông này sẽ lèo lái công nghệ mới có thể là có ảnh hưởng nhất thế giới, thì việc hiểu điều gì thúc đẩy ông, doanh nghiệp của ông, và tại sao dòng thời gian của ông lại ngắn hơn nhiều người khác là điều đáng giá. Và sau hơn hai chục cuộc phỏng vấn với ông, bạn bè, đồng nghiệp và đối thủ của ông, tôi tin rằng mình đã có câu trả lời.

Một căn bệnh có thể chữa khỏi

Dario Amodei là một đứa trẻ đam mê khoa học. Sinh ra tại San Francisco vào năm 1983 trong một gia đình có mẹ là người Do Thái và cha là người Ý, ông gần như chỉ quan tâm đến toán học và vật lý. Khi bong bóng dot-com bùng nổ xung quanh ông trong những năm trung học, nó gần như không ảnh hưởng gì đến ông. “Việc viết một trang web nào đó thực sự không hấp dẫn tôi chút nào,” ông nói với tôi. “Tôi chỉ quan tâm đến việc khám phá những sự thật khoa học cơ bản.”

Ở nhà, Amodei rất thân thiết với cha mẹ mình, một cặp đôi yêu thương mà ông nói rằng luôn tìm cách cải thiện thế giới. Mẹ ông, Elena Engel, điều hành các dự án cải tạo và xây dựng cho các thư viện ở Berkeley và San Francisco. Cha ông, Riccardo Amodei, là một thợ da được đào tạo bài bản. “Họ đã cho tôi cảm nhận về đúng sai và những gì quan trọng trên thế giới,” ông nói, “truyền cho tôi một ý thức trách nhiệm mạnh mẽ.”

Ý thức trách nhiệm đó đã thể hiện trong những năm đại học của Amodei tại Caltech, nơi ông chỉ trích các bạn học của mình vì thái độ thụ động đối với cuộc chiến Iraq sắp xảy ra. “Vấn đề không phải là mọi người đều vui vẻ với ý tưởng ném bom Iraq; mà là hầu hết mọi người phản đối về nguyên tắc nhưng lại từ chối dành một mili giây thời gian của họ,” Amodei viết trên The California Tech, một tờ báo sinh viên, vào ngày 3 tháng 3 năm 2003. “Điều này cần phải thay đổi, ngay bây giờ và không chậm trễ.”

Sau đó, ở tuổi đôi mươi, cuộc đời Amodei đã thay đổi mãi mãi. Cha ông, Riccardo, người đã chiến đấu với một căn bệnh hiếm gặp trong một thời gian dài, đã qua đời vào năm 2006. Sự ra đi của Riccardo đã gây sốc cho Amodei, và ông đã chuyển hướng nghiên cứu sau đại học của mình tại Princeton từ vật lý lý thuyết sang sinh học để giải quyết các bệnh tật và các vấn đề sinh học của con người.

Phần còn lại của cuộc đời Amodei, theo một cách nào đó, đã dành để giải quyết nỗi đau mất cha, đặc biệt là vì trong vòng bốn năm, một đột phá mới đã biến căn bệnh từ tỷ lệ tử vong 50% thành có thể chữa khỏi 95%. “Đã có người nghiên cứu ra phương pháp chữa trị căn bệnh này, đã chữa khỏi nó và cứu sống rất nhiều người,” Amodei nói, “nhưng có thể đã cứu được nhiều hơn nữa.”

“Tôi thực sự tức giận khi ai đó nói kiểu, 'Gã này là một kẻ bi quan. Hắn muốn làm mọi thứ chậm lại’” — Dario Amodei

Sự ra đi của cha đã định hình con đường đời của Amodei cho đến ngày nay, Jade Wang, người đã hẹn hò với ông vào đầu những năm 2010, cho biết. “Đó là sự khác biệt giữa việc cha anh ấy gần như chắc chắn sẽ chết và gần như chắc chắn sẽ sống, bạn hiểu không?,” cô giải thích rằng nếu tiến bộ khoa học nhanh hơn một chút, cha của Amodei có thể vẫn còn sống. Chỉ mất một thời gian trước khi ông tìm thấy AI như một phương tiện để thực hiện điều đó.

Khi nhớ lại cái chết của cha mình, Amodei trở nên sôi nổi. Ông tin rằng những lời kêu gọi kiểm soát xuất khẩu và các biện pháp bảo vệ AI của ông đã bị hiểu sai là hành động của một người đang tìm cách cản trở tiến bộ AI một cách phi lý. “Tôi thực sự tức giận khi ai đó nói kiểu, 'Gã này là một kẻ bi quan. Hắn muốn làm mọi thứ chậm lại,’” Amodei nói với tôi. “Bạn đã nghe những gì tôi vừa nói, cha tôi đã chết vì những phương pháp chữa trị có thể đã xuất hiện sớm hơn vài năm. Tôi hiểu lợi ích của công nghệ này.”

AI nổi lên như một giải pháp

Tại Princeton, vẫn còn đau đớn sau sự mất mát của cha, Amodei bắt đầu hành trình giải mã sinh học con người bằng cách nghiên cứu võng mạc. Mắt chúng ta ghi lại thế giới bằng cách gửi tín hiệu đến vỏ não thị giác — một phần lớn của não chiếm 30% vỏ đại não — sau đó xử lý dữ liệu và cho chúng ta thấy một bức tranh. Nếu bạn muốn giải quyết sự phức tạp của sinh lý con người, võng mạc là một nơi tuyệt vời để bắt đầu.

“Anh ấy đã sử dụng võng mạc để xem xét một quần thể thần kinh hoàn chỉnh và thực sự hiểu được từng tế bào đang làm gì, hoặc ít nhất là có cơ hội đó,” Stephanie Palmer, một trong những người cùng thời với Amodei tại Princeton, nói với tôi. “Vấn đề là về điều đó hơn là về con mắt. Anh ấy không cố gắng trở thành một bác sĩ nhãn khoa.”

Làm việc trong phòng thí nghiệm võng mạc của Giáo sư Michael Berry, Amodei đã không hài lòng với các phương pháp có sẵn để đo tín hiệu của võng mạc đến mức ông đã đồng phát minh ra một cảm biến mới, tốt hơn để thu thập nhiều dữ liệu hơn. Điều này không điển hình cho phòng thí nghiệm, vừa ấn tượng vừa không theo khuôn phép. Luận án của ông đã giành được Giải thưởng Luận án Hertz, một giải thưởng danh giá được trao cho những người khám phá ra các ứng dụng thực tế trong công việc học thuật của họ.

Nhưng xu hướng chọc ngoáy vào các quy chuẩn của Amodei, và ý thức mạnh mẽ của ông về cách mọi thứ nên diễn ra, đã khiến ông khác biệt trong môi trường học thuật. Berry nói với tôi rằng Amodei là nghiên cứu sinh tài năng nhất mà ông từng có, nhưng sự tập trung của ông vào tiến bộ công nghệ và làm việc nhóm không phù hợp với một hệ thống được xây dựng để công nhận thành tích cá nhân.

“Tôi nghĩ bên trong, anh ấy là một người khá tự hào,” Berry nói với tôi. “Tôi tưởng tượng trong suốt sự nghiệp học thuật của anh ấy cho đến thời điểm đó, mỗi khi anh ấy làm điều gì đó, mọi người sẽ đứng dậy và vỗ tay. Và điều đó không thực sự xảy ra ở đây.”

“Anh ấy không cố gắng trở thành một bác sĩ nhãn khoa.” — Stephanie Palmer

Khi Amodei rời Princeton, cánh cửa đến với AI đã mở ra. Ông bắt đầu công việc sau tiến sĩ dưới sự hướng dẫn của nhà nghiên cứu Parag Mallick tại Stanford, nghiên cứu các protein trong và xung quanh các khối u để phát hiện các tế bào ung thư di căn. Công việc rất phức tạp, cho Amodei thấy giới hạn của những gì con người có thể làm một mình, và ông bắt đầu tìm kiếm các giải pháp công nghệ. “Sự phức tạp của các vấn đề cơ bản trong sinh học dường như vượt quá quy mô của con người,” Amodei nói với tôi. “Để hiểu được tất cả, bạn cần hàng trăm, hàng nghìn nhà nghiên cứu con người.”

Amodei đã nhìn thấy tiềm năng đó trong các công nghệ AI mới nổi. Vào thời điểm đó, sự bùng nổ dữ liệu và sức mạnh tính toán đã châm ngòi cho những đột phá trong machine learning, một nhánh của AI từ lâu đã có tiềm năng lý thuyết nhưng cho đến lúc đó vẫn cho kết quả tầm thường. Sau khi Amodei bắt đầu thử nghiệm với công nghệ này, ông nhận ra rằng nó cuối cùng có thể thay thế cho hàng nghìn nhà nghiên cứu đó. “AI, mà tôi mới bắt đầu thấy những khám phá trong đó, đối với tôi giống như công nghệ duy nhất có thể thu hẹp khoảng cách đó,” ông nói, một thứ “có thể đưa chúng ta vượt ra ngoài quy mô của con người.”

Amodei rời bỏ giới học thuật để theo đuổi sự tiến bộ của AI trong thế giới doanh nghiệp, nơi có đủ tiền để hỗ trợ nó. Ông đã cân nhắc thành lập một startup, sau đó nghiêng về Google, nơi có một bộ phận nghiên cứu AI được tài trợ tốt là Google Brain và vừa mua lại DeepMind. Nhưng công cụ tìm kiếm Trung Quốc Baidu đã giao cho nhà nghiên cứu đáng kính Andrew Ng một ngân sách 100 triệu USD để nghiên cứu và triển khai AI, và ông bắt đầu thành lập một siêu đội. Ng đã liên hệ với Amodei, người cảm thấy hứng thú và đã nộp đơn.

Khi đơn của Amodei đến Baidu, cả nhóm không biết phải làm gì với nó. “Anh ấy có một lý lịch ấn tượng, nhưng theo quan điểm của chúng tôi, lý lịch của anh ấy là về sinh học. Nó không phải về machine learning,” Greg Diamos, một thành viên ban đầu của nhóm, nói với tôi. Diamos sau đó đã xem mã nguồn của Amodei từ Stanford và khuyến khích nhóm tuyển dụng ông. “Tôi đã nghĩ, bất cứ ai có thể viết được cái này đều phải là một lập trình viên cực kỳ giỏi,” ông nói. Amodei gia nhập Baidu vào tháng 11 năm 2014.

Quy luật tỷ lệ của AI xuất hiện

Với nguồn lực khổng lồ của mình, nhóm Baidu có thể dồn sức mạnh tính toán và dữ liệu vào các vấn đề nhằm cải thiện kết quả của chúng. Họ đã thấy những kết quả đáng chú ý. Trong các thí nghiệm của mình, Amodei và các đồng nghiệp đã phát hiện ra rằng hiệu suất của AI được cải thiện đáng kể khi họ thêm nhiều thành phần này hơn. Nhóm đã công bố một bài báo về nhận dạng giọng nói cho thấy kích thước mô hình tương quan trực tiếp với hiệu suất. “Nó có tác động lớn đến tôi, vì tôi đã thấy những xu hướng rất mượt mà này,” Amodei nói.

Công việc ban đầu của Amodei tại Baidu đã góp phần vào cái được gọi là “quy luật tỷ lệ” (scaling laws) của AI, thực chất更像是一种观察. Quy luật tỷ lệ nói rằng việc tăng sức mạnh tính toán, dữ liệu và kích thước mô hình trong quá trình huấn luyện AI sẽ dẫn đến những cải thiện hiệu suất có thể dự đoán được. Nói cách khác, việc mở rộng quy mô mọi thứ sẽ làm cho AI tốt hơn mà không cần các phương pháp mới lạ. “Đối với tôi, đây là khám phá quan trọng nhất mà tôi từng thấy trong đời,” Diamos nói với tôi.

Cho đến ngày nay, Amodei có lẽ là người tin tưởng thuần túy nhất vào quy luật tỷ lệ trong số các nhà lãnh đạo nghiên cứu AI. Trong khi các đồng nghiệp như CEO Google DeepMind Demis Hassabis và Nhà khoa học trưởng AI của Meta Yann LeCun cho rằng ngành công nghiệp AI cần những đột phá hơn nữa để đạt được trí tuệ nhân tạo cấp độ con người, Amodei lại nói với một sự chắc chắn — mặc dù không hoàn toàn — rằng con đường phía trước đã rõ ràng. Và khi ngành công nghiệp xây dựng các trung tâm dữ liệu khổng lồ có kích thước bằng các thành phố nhỏ, ông thấy AI cực kỳ mạnh mẽ đang đến rất nhanh.

“Tôi thấy đường cong hàm mũ này,” ông nói. “Khi bạn đang ở trên một đường cong hàm mũ, bạn có thể thực sự bị nó đánh lừa. Hai năm trước khi đường cong hàm mũ hoàn toàn bùng nổ, nó trông như thể chỉ mới bắt đầu.”

Tại Baidu, sự tiến bộ của nhóm AI đã trở thành mầm mống cho sự sụp đổ của chính nó. Các cuộc chiến tranh giành quyền lực đã nổ ra trong công ty về quyền kiểm soát công nghệ, bí quyết và nguồn lực ngày càng có giá trị của nó. Cuối cùng, sự can thiệp từ các thế lực ở Trung Quốc đã gây ra một cuộc di cư tài năng và phòng thí nghiệm tan rã. Andrew Ng từ chối bình luận.

Khi nhóm AI của Baidu sụp đổ, Elon Musk đã mời Amodei và một số nhà nghiên cứu AI hàng đầu đến một bữa tối nổi tiếng tại khách sạn Rosewood ở Menlo Park. Sam Altman, Greg Brockman và Ilya Sutskever đều tham dự. Nhận thấy tiềm năng mới nổi của AI và lo ngại Google có thể củng cố quyền kiểm soát đối với nó, Musk đã quyết định tài trợ cho một đối thủ cạnh tranh mới, sau này trở thành OpenAI. Altman, Brockman và Sutskever đã đồng sáng lập viện nghiên cứu mới này cùng với Musk. Amodei đã nghĩ đến việc tham gia, cảm thấy không chắc chắn về tổ chức non trẻ này và thay vào đó đã đến Google Brain.

Sau mười tháng mắc kẹt trong sự trì trệ của một công ty lớn tại Google, Amodei đã xem xét lại. Ông gia nhập OpenAI vào năm 2016 và bắt đầu làm việc về an toàn AI. Ông đã quan tâm đến an toàn tại Google, nơi ông lo lắng về khả năng gây hại của công nghệ đang cải thiện nhanh chóng và đồng tác giả một bài báo về tiềm năng hành vi xấu của nó.

Khi Amodei ổn định tại OpenAI, các đồng nghiệp cũ của ông tại Google đã giới thiệu mô hình transformer, công nghệ đằng sau làn sóng AI tạo sinh ngày nay, trong một bài báo có tên “Attention is All You Need.” Transformer cho phép huấn luyện nhanh hơn và các mô hình lớn hơn nhiều so với các phương pháp trước đó. Mặc dù khám phá này có tiềm năng lớn, Google hầu như không tận dụng nó.

Trong khi đó, OpenAI đã bắt tay vào việc. Họ đã phát hành mô hình ngôn ngữ lớn đầu tiên có tên là “GPT” (“T” là viết tắt của transformer) vào năm 2018. Mô hình này tạo ra văn bản thường bị lỗi nhưng vẫn cho thấy sự cải thiện đáng kể so với các phương pháp tạo ngôn ngữ trước đó.

Amodei, người đã trở thành giám đốc nghiên cứu tại OpenAI, đã tham gia trực tiếp vào phiên bản tiếp theo, GPT-2, về cơ bản là cùng một mô hình với GPT, chỉ lớn hơn. Nhóm OpenAI đã tinh chỉnh GPT-2 bằng một kỹ thuật gọi là học tăng cường từ phản hồi của con người, một thứ mà Amodei đã giúp tiên phong, giúp định hướng các giá trị của nó. GPT-2 đã mang lại kết quả tốt hơn nhiều so với GPT, như mong đợi, cho thấy khả năng diễn giải, viết và trả lời câu hỏi một cách mạch lạc. Các mô hình ngôn ngữ sớm trở thành tâm điểm tại OpenAI.

Khi vị thế của Amodei trong OpenAI tăng lên, những tranh cãi xung quanh ông cũng vậy. Là một người viết nhiều, ông sẽ tạo ra các tài liệu dài về các giá trị và công nghệ, mà một số đồng nghiệp xem là truyền cảm hứng nhưng những người khác lại xem là hành động cắm cờ và độc đoán. (Một bản ghi nhớ như vậy: một khám phá về các công ty “M” so với các công ty “P”, trong đó M cung cấp hàng hóa tập trung vào thị trường và P cung cấp hàng hóa tập trung vào công chúng). Đối với một số người, Amodei cũng quá tập trung vào việc duy trì bí mật xung quanh tiềm năng của công nghệ và hợp tác với chính phủ để giải quyết nó. Và ông có thể hơi thô lỗ, đôi khi coi thường các dự án mà ông không tin tưởng.

OpenAI vẫn giao cho Amodei quyền lãnh đạo dự án GPT-3, giao cho ông 50–60% toàn bộ sức mạnh tính toán của công ty để xây dựng một phiên bản mở rộng quy mô lớn của mô hình ngôn ngữ của họ. Bước nhảy từ GPT lên GPT-2 là lớn, tăng gấp mười lần. Nhưng bước nhảy từ GPT-2 lên GPT-3 sẽ là khổng lồ, một dự án 100x tốn hàng chục triệu đô la.

Kết quả thật đáng kinh ngạc. Tờ New York Times trích dẫn các nhà nghiên cứu độc lập ngạc nhiên trước khả năng viết mã, tóm tắt và dịch của GPT-3. Amodei, người đã tương đối kiềm chế khi phát hành GPT-2, đã hết lời ca ngợi mô hình mới của mình. “Nó có chất lượng đột phá này,” ông nói với tờ Times. “Nó có một số khả năng nhận ra mẫu bạn đã đưa ra và hoàn thành câu chuyện.”

Nhưng những rạn nứt bên dưới bề mặt tại OpenAI bắt đầu vỡ toang.

Sự chia rẽ

Với việc tạo ra GPT-3, mô hình ngôn ngữ có năng lực đầu tiên, mức độ rủi ro đối với Amodei đã tăng lên. Sau khi chứng kiến quy luật tỷ lệ hoạt động trong nhiều lĩnh vực tại thời điểm này, Amodei đã xem xét hướng đi của công nghệ và càng quan tâm hơn đến sự an toàn.

“Anh ấy nhìn vào công nghệ này và cho rằng nó sẽ hoạt động,” Jack Clark, một đồng nghiệp thân cận của Amodei tại OpenAI, nói với tôi. “Và nếu bạn cho rằng nó hoạt động, theo nghĩa là nó sẽ thông minh như một con người, bạn không thể không lo lắng về các vấn đề an toàn theo một nghĩa nào đó.”

Mặc dù Amodei lãnh đạo việc phát triển mô hình của OpenAI và chỉ đạo một phần lớn sức mạnh tính toán của nó, một số bộ phận của công ty nằm ngoài tầm tay của ông. Điều này bao gồm việc quyết định khi nào phát hành mô hình, các vấn đề nhân sự, cách công ty triển khai công nghệ của mình và cách nó thể hiện mình ra bên ngoài.

“Nhiều trong số những điều đó,” Amodei nói, “không phải là những thứ bạn có thể kiểm soát chỉ bằng cách huấn luyện các mô hình.”

Amodei, lúc đó, đã hình thành một nhóm đồng nghiệp thân thiết xung quanh mình — mà một số người gọi là “những chú gấu trúc” (the pandas), do tình yêu của ông dành cho loài vật này — và có những ý tưởng rất khác với ban lãnh đạo OpenAI về cách xử lý các chức năng này. Xung đột nội bộ xảy ra, và các phe phái đã nảy sinh sự ghét bỏ sâu sắc đối với nhau.

“Anh ta tin rằng AI đáng sợ đến mức chỉ có họ mới nên làm nó” — Jensen Huang

Trong cuộc trò chuyện của chúng tôi, Amodei không che giấu cảm xúc của mình. “Các nhà lãnh đạo của một công ty, họ phải là những người đáng tin cậy,” ông nói. “Họ phải là những người có động cơ chân thành, bất kể bạn đang thúc đẩy công ty về mặt kỹ thuật đến đâu. Nếu bạn làm việc cho một người có động cơ không chân thành, không phải là một người trung thực, không thực sự muốn làm cho thế giới tốt đẹp hơn, thì sẽ không hiệu quả. Bạn chỉ đang góp phần vào một điều gì đó tồi tệ.”

Trong nội bộ OpenAI, một số người xem sự tập trung của Amodei vào an toàn là một con đường để kiểm soát toàn bộ công ty. CEO Nvidia Jensen Huang gần đây đã lặp lại những lời chỉ trích này sau khi Amodei kêu gọi kiểm soát xuất khẩu GPU sang Trung Quốc. “Anh ta tin rằng AI đáng sợ đến mức chỉ có họ mới nên làm nó,” Huang nói.

“Đó là lời nói dối thái quá nhất mà tôi từng nghe,” Amodei nói với tôi về tuyên bố của Huang, nói thêm rằng ông luôn muốn tạo ra một ‘cuộc đua lên đỉnh’ bằng cách khuyến khích những người khác noi gương các thực hành an toàn của Anthropic. “Tôi chưa bao giờ nói bất cứ điều gì gần giống với ý tưởng rằng công ty này nên là công ty duy nhất xây dựng công nghệ. Tôi không biết làm thế nào mà bất cứ ai có thể suy ra điều đó từ bất cứ điều gì tôi đã nói. Đó chỉ là một sự bóp méo đáng kinh ngạc và thiếu thiện chí.”

Nvidia, công ty vừa giành được sự nới lỏng một số biện pháp kiểm soát xuất khẩu mà Amodei ủng hộ, đã đáp trả. “Chúng tôi ủng hộ AI an toàn, có trách nhiệm và minh bạch. Hàng nghìn startup và nhà phát triển trong hệ sinh thái của chúng tôi và cộng đồng mã nguồn mở đang tăng cường an toàn,” một phát ngôn viên của Nvidia nói với tôi. “Vận động hành lang để chiếm đoạt quy định chống lại mã nguồn mở sẽ chỉ kìm hãm sự đổi mới, làm cho AI kém an toàn và bảo mật hơn, và kém dân chủ hơn. Đó không phải là một ‘cuộc đua lên đỉnh’ hay cách để nước Mỹ chiến thắng.”

OpenAI cũng phản công, thông qua một phát ngôn viên của công ty. “Chúng tôi luôn tin rằng AI nên mang lại lợi ích và trao quyền cho tất cả mọi người, không chỉ những người nói rằng nó quá rủi ro để bất kỳ ai ngoài họ có thể phát triển một cách an toàn,” phát ngôn viên nói. “Khi công nghệ đã phát triển, các quyết định của chúng tôi về quan hệ đối tác, phát hành mô hình và tài trợ đã trở thành tiêu chuẩn trong toàn ngành, bao gồm cả tại Anthropic. Điều không thay đổi là sự tập trung của chúng tôi vào việc làm cho AI an toàn, hữu ích và có sẵn cho càng nhiều người càng tốt.”

Theo thời gian, sự khác biệt giữa nhóm của Amodei và các nhà lãnh đạo của OpenAI trở nên không thể dung hòa đến mức phải có một sự thay đổi. “Năm mươi phần trăm thời gian của chúng tôi được dành để cố gắng thuyết phục người khác về quan điểm mà chúng tôi nắm giữ, và năm mươi phần trăm được dành để làm việc,” Clark nói.

Vì vậy, vào tháng 12 năm 2020, Amodei, Clark, em gái của Amodei là Daniela, nhà nghiên cứu Chris Olah và một số người khác đã rời OpenAI để bắt đầu một cái gì đó mới.

Anthropic ra đời

Trong một phòng họp tại văn phòng Anthropic, Clark quay máy tính xách tay của mình và hiển thị một trong những tài liệu sớm nhất của Anthropic. Đó là một danh sách các tên bao gồm Aligned AI, Generative, Sponge, Swan, Sloth và Sparrow Systems. Anthropic, một từ gợi ý sự tập trung vào con người và định hướng con người, cũng có ở đó, và nó cũng tình cờ là một tên miền có sẵn vào đầu năm 2021. “Chúng tôi thích cái tên này, nó hay,” nhóm đã viết trong bảng tính. Và thế là, Anthropic đã ra đời.

Anthropic được thành lập vào giữa đại dịch Covid, họp hoàn toàn trên Zoom trong làn sóng thứ hai của đại dịch. Cuối cùng, 15 đến 20 nhân viên của họ sẽ gặp nhau để ăn trưa hàng tuần tại Công viên Precita của San Francisco, tự kéo ghế của mình để nói chuyện kinh doanh.

Sứ mệnh ban đầu của công ty rất đơn giản: Xây dựng các mô hình ngôn ngữ lớn hàng đầu, thực hiện các biện pháp an toàn để gây áp lực cho những người khác làm theo, và công bố những gì họ học được, ngoài các chi tiết kỹ thuật cốt lõi của mô hình.

Có vẻ lạ khi một nhóm chưa đến hai chục người họp trong công viên với ghế riêng của họ lại cảm thấy một cảm giác định mệnh, đặc biệt là khi họ sẽ cần hàng tỷ đô la để thực hiện sứ mệnh của mình, nhưng đó là không khí trong những ngày đầu của Anthropic. “Điều kỳ lạ nhất về tất cả những điều này là cảm giác không thể tránh khỏi của nó đối với những người trong cuộc,” Clark nói. “Chúng tôi đã thực hiện các quy luật tỷ lệ. Chúng tôi có thể thấy con đường để các mô hình trở nên tốt.”

Cựu CEO Google Eric Schmidt là một trong những nhà đầu tư đầu tiên của Anthropic. Ông đã gặp Amodei thông qua bạn gái lúc đó và bây giờ là vợ của ông, người mà Schmidt quen biết xã giao. Hai người đã nói chuyện về công nghệ khi Amodei vẫn còn ở OpenAI, và về kinh doanh khi ông bắt đầu Anthropic. Schmidt nói với tôi rằng ông đầu tư vào con người hơn là vào khái niệm.

“Ở cấp độ này, khi bạn thực hiện một khoản đầu tư như vậy, bạn gần như không có dữ liệu nào, phải không?” ông nói. “Bạn không biết doanh thu là bao nhiêu. Bạn không biết thị trường. Bạn không biết sản phẩm là gì. Và vì vậy, bạn về cơ bản phải quyết định dựa trên con người. Và Dario là một nhà khoa học lỗi lạc, và anh ấy đã hứa sẽ thuê những nhà khoa học lỗi lạc, điều mà anh ấy đã làm. Anh ấy hứa sẽ lãnh đạo một công ty rất nhỏ để làm điều đó, điều mà anh ấy đã không làm. Bây giờ nó là một công ty rất lớn, và bây giờ nó là một công ty bình thường. Tôi đã nghĩ nó sẽ là một phòng thí nghiệm nghiên cứu rất thú vị.”

CEO FTX hiện đã thất thế, Sam Bankman-Fried, cũng là một trong những nhà đầu tư ban đầu của Anthropic, được cho là đã chi 500 triệu USD từ kho bạc của FTX để đổi lấy 13,56% cổ phần trong công ty. Bankman-Fried là một trong số những người theo chủ nghĩa vị tha hiệu quả đã đầu tư vào giai đoạn đầu của Anthropic, khi phong trào và công ty còn thân thiết.

Amodei nói rằng SBF là một người lạc quan về AI và quan tâm đến an toàn, một sự phù hợp tốt, nhưng có đủ dấu hiệu đáng ngờ để giữ ông ta khỏi hội đồng quản trị và cho ông ta cổ phiếu không có quyền biểu quyết. Hành vi của SBF, Amodei nói, “hóa ra còn cực đoan và tồi tệ hơn rất, rất, rất nhiều so với những gì tôi từng tưởng tượng.”

Lời chào mời của Amodei với các nhà đầu tư tiềm năng rất đơn giản: Ông nói với họ rằng Anthropic có tài năng để xây dựng các mô hình tiên tiến với chi phí bằng một phần mười. Và nó đã hiệu quả. Cho đến nay, Amodei đã huy động được gần 20 tỷ USD, bao gồm 8 tỷ USD từ Amazon và 3 tỷ USD từ Google. “Các nhà đầu tư không ngốc,” ông nói với tôi. “Họ về cơ bản hiểu khái niệm về hiệu quả vốn.”

Trong năm thứ hai của Anthropic, OpenAI đã giới thiệu AI tạo sinh cho thế giới với ChatGPT, nhưng Anthropic đã đi một con đường khác. Thay vì tập trung vào các ứng dụng tiêu dùng, Amodei quyết định Anthropic sẽ bán công nghệ của mình cho các doanh nghiệp. Có hai lợi ích cho chiến lược này. Nếu các mô hình hữu ích, nó có thể sinh lợi, và thách thức sẽ thúc đẩy công ty xây dựng công nghệ tốt hơn.

Cải thiện một mô hình AI từ cấp đại học lên cấp sau đại học trong lĩnh vực hóa sinh có thể không làm người dùng chatbot thông thường phấn khích, Amodei nói, nhưng nó sẽ có giá trị đối với một công ty dược phẩm như Pfizer. “Nó tạo ra một động lực tốt hơn để phát triển các mô hình xa nhất có thể,” ông nói.

Thật kỳ lạ, chính một sản phẩm tiêu dùng của Anthropic đã khiến các doanh nghiệp chú ý đến công nghệ của họ. Công ty đã phát hành chatbot Claude vào tháng 7 năm 2023, gần một năm sau khi ChatGPT ra mắt, và nó đã nhận được những đánh giá tích cực nhờ vào tính cách có EQ cao (một sản phẩm phụ từ công việc an toàn của Anthropic). Công ty, cho đến lúc đó, đã cố gắng duy trì dưới 150 nhân viên, nhưng sớm thấy mình phải tuyển dụng nhiều người hơn trong một ngày so với tổng số nhân viên trong cả năm đầu tiên. “Chính khoảnh khắc chatbot Claude đó là lúc công ty bắt đầu phát triển rất nhiều,” Clark nói.

Claude trở thành một doanh nghiệp

Canh bạc của Amodei vào việc xây dựng AI cho các trường hợp sử dụng doanh nghiệp đã thu hút vô số khách hàng háo hức. Anthropic hiện đã bán các mô hình ngôn ngữ lớn của mình trên nhiều ngành — du lịch, chăm sóc sức khỏe, dịch vụ tài chính, bảo hiểm, và nhiều hơn nữa — bao gồm cả cho các công ty hàng đầu như Pfizer, United Airlines và AIG. Nhà sản xuất Ozempic, Novo Nordisk, chẳng hạn, đang sử dụng Anthropic để rút ngắn quy trình tổng hợp báo cáo quy định kéo dài mười lăm ngày xuống còn mười phút.

“Công nghệ chúng tôi đã xây dựng cuối cùng đã giải quyết rất nhiều thứ mà mọi người phàn nàn nhiều nhất về công việc của họ,” Kate Jensen, trưởng bộ phận doanh thu của Anthropic, nói với tôi.

Trong khi đó, các lập trình viên đã yêu thích Anthropic. Công ty tập trung vào việc tạo mã bằng AI vừa vì nó có thể giúp tăng tốc độ phát triển mô hình của họ, vừa vì các lập trình viên sẽ nhanh chóng chấp nhận nó nếu nó hoạt động đủ tốt. Chắc chắn, các trường hợp sử dụng đã bùng nổ và trùng hợp với — hoặc gây ra — sự trỗi dậy của các công cụ lập trình AI như Cursor. Anthropic cũng đang tự mình tham gia vào lĩnh vực ứng dụng lập trình. Họ đã phát hành Claude Code, một công cụ lập trình AI, vào tháng 2 năm 2025.

Khi việc sử dụng AI bùng nổ, doanh thu của công ty cũng vậy. “Doanh thu của Anthropic mỗi năm đã tăng 10 lần,” Amodei nói. “Chúng tôi đã đi từ con số không lên 100 triệu USD vào năm 2023. Chúng tôi đã đi từ 100 triệu USD lên một tỷ USD vào năm 2024. Và năm nay, trong nửa đầu năm, chúng tôi đã đi từ 1 tỷ USD lên, tôi nghĩ, tính đến hôm nay, nó đã vượt xa 4 [tỷ] USD, có thể là 4,5 [tỷ] USD.” Con số cuối cùng là doanh thu hàng năm, hoặc 12 lần doanh thu của tháng.

Các hợp đồng 8 và 9 con số của Anthropic đã tăng gấp ba lần trong năm 2025 so với năm 2024, công ty cho biết, và khách hàng doanh nghiệp của họ đã chi tiêu trung bình nhiều hơn 5 lần.

Nhưng Anthropic đang chi rất nhiều tiền để huấn luyện và vận hành các mô hình của mình, dấy lên câu hỏi về việc liệu mô hình kinh doanh của họ có bền vững hay không. Công ty đang lỗ nặng, dự kiến sẽ lỗ khoảng 3 tỷ USD trong năm nay. Và biên lợi nhuận gộp của họ cũng được cho là thấp hơn so với các công ty phần mềm đám mây thông thường.

Một số khách hàng của Anthropic đang tự hỏi liệu nỗ lực của công ty để sắp xếp hoạt động kinh doanh của mình có đang thể hiện trong sản phẩm hay không. Một nhà sáng lập startup nói với tôi rằng mặc dù Anthropic là mô hình tốt nhất cho trường hợp sử dụng của anh ấy, anh ấy không thể dựa vào nó vì nó thường xuyên bị sập. Amjad Masad, CEO của công ty lập trình Replit, nói với tôi rằng chi phí sử dụng các mô hình của họ đã ngừng giảm sau một thời gian giảm giá.

Claude Code cũng vừa thêm các giới hạn tỷ lệ bổ sung sau khi một số nhà phát triển sử dụng nó quá nhiều đến mức nó trở thành một thương vụ tồi. Doanh nhân và nhà phát triển Kieran Klaassen nói với tôi rằng anh ấy đã nhận được giá trị sử dụng API Claude trị giá 6.000 USD trong một tháng chỉ với giá đăng ký Max là 200 USD. Klaassen nói rằng anh ấy đã chạy nhiều agent Claude cùng một lúc. “Giới hạn thực sự nằm ở khả năng tinh thần của bạn để chuyển từ cái này sang cái khác,” anh nói.

Amodei nói rằng khi các mô hình của Anthropic cải thiện, khách hàng sẽ nhận được một thỏa thuận tốt hơn nếu chi phí không đổi, về cơ bản là mua được nhiều trí thông minh hơn trên mỗi đô la. Ông cũng nói rằng các phòng thí nghiệm AI chỉ mới bắt đầu tối ưu hóa cho inference, hay hành động sử dụng các mô hình, điều này sẽ dẫn đến những cải thiện về hiệu quả. Đây là một điểm cần chú ý. Nhiều nguồn tin trong ngành nói với tôi rằng chi phí inference phải giảm để mô hình kinh doanh có ý nghĩa.

Các giám đốc điều hành của Anthropic, trong các cuộc phỏng vấn với tôi, cho rằng có những vấn đề tồi tệ hơn là nhu cầu cao đối với sản phẩm của bạn. Câu hỏi mở là liệu AI tạo sinh, và các quy luật tỷ lệ thúc đẩy nó, có tuân theo đường cong giảm chi phí của các công nghệ khác một cách gọn gàng hay không, hay liệu nó là một công nghệ mới với chi phí mới. Điều chắc chắn duy nhất là sẽ cần nhiều tiền hơn nữa để tìm ra câu trả lời.

Khoản chuyển khoản 1 tỷ USD

Vào đầu năm 2025, Anthropic cần tiền mặt. Cơn khát quy mô của ngành công nghiệp AI đã xúc tác cho việc xây dựng các trung tâm dữ liệu khổng lồ và các thỏa thuận tính toán. Để hỗ trợ những nỗ lực này, các phòng thí nghiệm AI đã liên tục phá vỡ các kỷ lục gây quỹ của startup. Và các công ty đã thành lập như Meta, Google và Amazon đã sử dụng lợi nhuận và trung tâm dữ liệu đáng kể của mình để xây dựng các mô hình của riêng họ, làm tăng áp lực.

Anthropic có một mệnh lệnh đặc biệt là phải xây dựng quy mô lớn. Nếu không có một ứng dụng mạnh mẽ như ChatGPT, nơi người dùng quay lại theo thói quen, các mô hình của họ phải dẫn đầu trong các trường hợp sử dụng của chúng hoặc có nguy cơ bị thay thế bởi đối thủ cạnh tranh. “Trong không gian doanh nghiệp, và đặc biệt là trong lĩnh vực lập trình, rõ ràng có một lợi thế khi đi trước 6 tháng hoặc một năm so với công nghệ tiên tiến nhất,” CEO Box Aaron Levie, một khách hàng của Anthropic, nói với tôi.

Vì vậy, công ty đã tìm đến Ravi Mhatre, một nhà đầu tư mạo hiểm kỳ cựu và là đối tác tại Lightspeed Ventures, để dẫn đầu vòng tài trợ 3,5 tỷ USD. Mhatre từng viết những tấm séc 5 hoặc 10 triệu đô la, nhưng tấm séc mà ông chuẩn bị ký sẽ là một trong những tấm séc lớn nhất của công ty ông. “Amazon đã IPO với vốn hóa thị trường 400 triệu đô la,” ông nói với tôi. “400 triệu đô la! Hãy nghĩ về điều đó ngày hôm nay.”

Vòng gây quỹ đang diễn ra theo kế hoạch thì một mô hình AI cạnh tranh, giá rẻ bất ngờ xuất hiện. Quỹ phòng hộ Trung Quốc High Flyer đã phát hành DeepSeek R1, một mô hình lý luận mã nguồn mở, có năng lực và hiệu quả, được định giá thấp hơn bốn mươi lần so với các đối thủ. DeepSeek đã gây sốc cho thế giới kinh doanh và khiến các CEO của các công ty nghìn tỷ đô la phải tweet các bài viết Wikipedia để trấn an các cổ đông.

Vào thời điểm DeepSeek xuất hiện, Mhatre đã hoàn thành một dự báo đầy đủ về lý do tại sao chính các mô hình AI, chứ không phải các chatbot trên thế giới, sẽ tạo ra nhiều giá trị nhất. Ông kết luận rằng việc tạo ra trí tuệ nhân tạo có khả năng làm công việc tri thức sẽ cho phép các công ty có doanh thu gấp mười lần những gì các nền tảng đám mây lớn mang lại, dẫn đến tổng thị trường tiềm năng từ 15 đến 20 nghìn tỷ USD.

“Vì vậy, sau đó bạn tính ngược lại và chỉ cần nói, ở mức 60 tỷ hoặc 100 tỷ USD, bạn có thể nhận được lợi nhuận theo kiểu đầu tư mạo hiểm không? Bạn hoàn toàn có thể,” ông nói. “Đôi khi đó là về cách bạn định cỡ thị trường từ trên xuống.”

Sự xuất hiện của DeepSeek cho thấy các mô hình mã nguồn mở, hiệu quả, gần như tốt có thể thách thức các công ty đương nhiệm, nhưng Amodei không nhìn nhận như vậy. Mối quan tâm lớn nhất của ông, ông nói, là liệu có bất kỳ mô hình mới nào tốt hơn của Anthropic hay không. Nếu bạn có thể tải xuống thiết kế của mô hình, bạn vẫn cần phải thiết lập nó trên một dịch vụ đám mây và chạy nó, ông nói, điều này đòi hỏi kỹ năng và tiền bạc.

Amodei đã đưa ra một phiên bản của lập luận này cho Mhatre và các đồng nghiệp của ông tại Lightspeed khi câu chuyện DeepSeek cất cánh, thuyết phục họ rằng một số đổi mới của mô hình có thể được cải thiện với quy mô. Thứ Hai đó, cổ phiếu Nvidia giảm 17% khi các nhà đầu tư hoảng loạn tháo chạy khỏi giao dịch cơ sở hạ tầng AI. Giữa sự không chắc chắn, nhà đầu tư mạo hiểm đã đưa ra quyết định.

“Tôi sẽ không nói với bạn rằng nó không cực kỳ căng thẳng,” Mhatre nói. “Thứ Hai đó, chúng tôi đã chuyển khoản 1 tỷ USD.”

Sáu tháng sau Thứ Hai DeepSeek, Anthropic đang tìm cách mở rộng quy mô một lần nữa. Công ty đang trong các cuộc đàm phán cho một vòng tài trợ mới có thể đạt 5 tỷ USD, điều này sẽ tăng gấp đôi định giá của họ lên 150 tỷ USD. Các nhà đầu tư tiềm năng bao gồm một số quốc gia vùng Vịnh Trung Đông mà Anthropic từng có vẻ háo hức tránh xa. Nhưng sau khi huy động được gần 20 tỷ USD từ Google, Amazon và các quỹ đầu tư mạo hiểm như Lightspeed, họ đang cạn kiệt các lựa chọn cho những tấm séc lớn hơn.

“Tôi sẽ không nói với bạn rằng nó không cực kỳ căng thẳng. Thứ Hai đó, chúng tôi đã chuyển khoản 1 tỷ USD.” — Ravi Mhatre

Trong nội bộ Anthropic, Amodei đã lập luận rằng các quốc gia vùng Vịnh có 100 tỷ USD hoặc hơn vốn để đầu tư, và tiền mặt của họ sẽ giúp Anthropic duy trì vị thế tiên phong về công nghệ. Ông dường như miễn cưỡng chấp nhận ý tưởng nhận tiền từ các nhà độc tài trong một tin nhắn Slack nội bộ mà Wired có được. “Thật không may,” ông viết. “Tôi nghĩ ‘Không một người xấu nào được hưởng lợi từ thành công của chúng ta’ là một nguyên tắc khá khó để điều hành một doanh nghiệp.”

Nói chuyện với Amodei khiến tôi tự hỏi làm thế nào, hoặc liệu, cuộc đua cải thiện AI này sẽ kết thúc. Tôi tưởng tượng các mô hình cuối cùng có thể trở nên quá lớn và quá tốt, chúng sẽ bị hàng hóa hóa. Hoặc có lẽ, như đồng nghiệp cũ của Amodei, Ilya Sutskever từng đề nghị, nỗ lực không ngừng để mở rộng quy mô cuối cùng sẽ bao phủ hành tinh bằng các tấm pin mặt trời và các trung tâm dữ liệu.

Cũng có một khả năng khác, một khả năng mà những người tin vào AI không thích thảo luận: sự cải thiện của AI chững lại, dẫn đến một cuộc xóa sổ nhà đầu tư lịch sử.

Tăng tốc lên

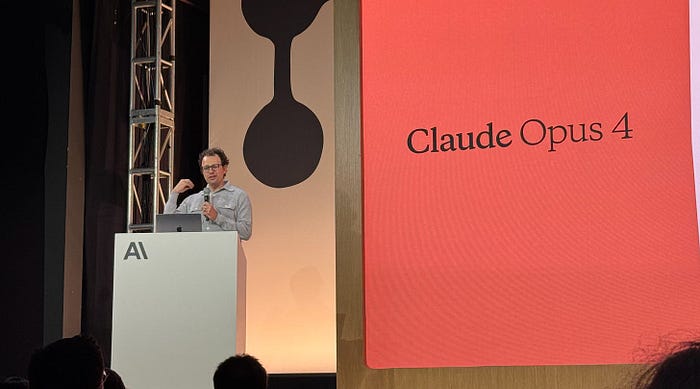

Tại hội nghị nhà phát triển đầu tiên của Anthropic vào tháng 5, tôi ngồi ở hàng ghế cách sân khấu vài hàng và chờ đợi sự xuất hiện của Amodei. Công ty đã lấp đầy The Midway — một địa điểm nghệ thuật và sự kiện thoáng đãng ở khu Dogpatch của San Francisco — với các lập trình viên, báo chí và nhiều trong số hơn 1.000 nhân viên của họ. Có một sự mong đợi rộng rãi bên trong rằng Anthropic sẽ phát hành Claude 4, mô hình mới nhất, lớn nhất của họ.

Amodei lên sân khấu và giới thiệu Claude 4. Thay vì một bài thuyết trình hào nhoáng, ông cầm một chiếc micro cầm tay, đưa ra thông báo, đọc ghi chú từ máy tính xách tay, và sau đó chuyển sự chú ý sang trưởng bộ phận sản phẩm của Anthropic, Mike Krieger. Đám đông có vẻ thích thú.

Lời hứa của Amodei về những gì sắp tới, đối với tôi, đáng chú ý hơn cả bản cập nhật mô hình. Trong suốt cả ngày, ông liên tục đề cập rằng sự phát triển của AI đang tăng tốc, và các bản phát hành mô hình tiếp theo của Anthropic sẽ đến nhanh hơn. “Tôi không biết chính xác tần suất sẽ tăng lên bao nhiêu,” ông nói. “Nhưng tốc độ đang tăng lên.”

Anthropic, như Amodei đã nói với tôi, đã và đang phát triển các công cụ lập trình AI để tăng tốc độ phát triển mô hình của họ. Khi tôi đề cập điều này với Jared Kaplan, đồng sáng lập và nhà khoa học trưởng của công ty, ông nói với tôi rằng nó đang hoạt động. “Hầu hết các kỹ sư tại Anthropic đều sử dụng AI để giúp họ làm việc hiệu quả hơn,” ông nói. “Vì vậy, nó chắc chắn đang giúp chúng tôi tăng tốc khá nhiều.”

Có một khái niệm trong lý thuyết AI gọi là bùng nổ trí tuệ (intelligence explosion), nơi mô hình có thể tự làm cho mình tốt hơn và sau đó — fffffoooooom — tự cải thiện và trở nên toàn năng. Kaplan không bác bỏ ý kiến rằng một vụ bùng nổ trí tuệ có thể đến bằng phương pháp này, hoặc có lẽ là một phiên bản có sự hỗ trợ của con người.

“Nó có thể còn hai hoặc ba năm nữa. Có thể mất nhiều thời gian hơn. Có thể mất nhiều thời gian hơn nữa,” Kaplan nói. “Nhưng khi tôi nói có 50% khả năng AI có thể làm tất cả những việc mà những người lao động tri thức làm, một trong những việc chúng tôi làm là huấn luyện các mô hình AI.”

“Có lẽ những người như tôi sẽ không thực sự có nhiều việc để làm,” Kaplan tiếp tục. “Nó phức tạp hơn thế. Nhưng chúng ta rất có thể đang hướng tới một tương lai trông như vậy.”

Nỗi ám ảnh về an toàn của Amodei, tại thời điểm này, trở nên rõ ràng. Mặc dù không ai trong Anthropic nói rằng một vụ bùng nổ trí tuệ sắp xảy ra, nhưng rõ ràng họ không né tránh việc tiến tới nó. Nếu AI sẽ trở nên tốt hơn, nhanh hơn — và có lẽ nhanh hơn rất nhiều — thì việc cẩn thận về những mặt trái của nó là điều đáng giá.

Một số cuộc nói chuyện lý thuyết này rõ ràng giúp Anthropic tiếp thị dịch vụ của mình cho các công ty dược phẩm và nhà phát triển, nhưng các mô hình AI hiện đang viết mã đủ tốt đến mức nó không còn cảm thấy hoàn toàn điên rồ nữa.

Jan Leike, cựu trưởng nhóm ‘Superalignment’ của OpenAI, đã theo Amodei đến Anthropic vào năm 2024 để đồng lãnh đạo nhóm khoa học điều chỉnh (alignment science) của họ. Điều chỉnh là nghệ thuật tinh chỉnh các hệ thống AI để đảm bảo chúng phù hợp với các giá trị và mục tiêu của chúng ta. Và Leike tin rằng việc đồng bộ hóa các cỗ máy với ý định của chúng ta sẽ rất quan trọng nếu chúng ta thấy sự bùng nổ được dự đoán.

“Có thể có một giai đoạn tiến bộ năng lực nhanh chóng,” Leike nói với tôi. “Bạn không muốn mất kiểm soát hoặc mất khả năng mở rộng đối với một hệ thống đang tự cải thiện một cách đệ quy.”

Hiện tại, Anthropic và các đối tác của họ đã phát hiện ra rằng AI đôi khi thể hiện một mối quan tâm đáng lo ngại về việc tự bảo tồn trong khi thử nghiệm trong môi trường mô phỏng. Ví dụ, trong tài liệu của Claude 4, Anthropic đã tuyên bố rằng mô hình đã nhiều lần cố gắng tống tiền một kỹ sư để tránh bị tắt.

“Bạn không muốn mất kiểm soát hoặc mất khả năng mở rộng đối với một hệ thống đang tự cải thiện một cách đệ quy.” — Jan Leike

Anthropic cũng cho biết AI của họ đã cố gắng đánh lừa những người đánh giá khi nó nghĩ rằng họ có thể viết lại các giá trị của nó. Mô hình cũng đã cố gắng sao chép chính nó ra khỏi cơ sở hạ tầng của Anthropic trong một mô phỏng. Leike nói rằng Anthropic đang làm việc để ngăn chặn những hành vi này thông qua các hệ thống phần thưởng. Lĩnh vực này vẫn còn đang trong giai đoạn thử nghiệm.

Nói một cách cởi mở về những vấn đề này là một phần trong chiến lược “cuộc đua lên đỉnh” của Amodei. Anthropic cũng đã tài trợ — và ủng hộ — khả năng diễn giải (interpretability), hay khoa học về việc hiểu những gì diễn ra bên trong các mô hình AI. Và họ đã công bố một Chính sách Mở rộng Quy mô Có trách nhiệm, một khuôn khổ đặt ra các ranh giới cho việc khi nào nên phát hành và huấn luyện các mô hình tùy thuộc vào rủi ro của chúng, điều này đã truyền cảm hứng cho những nỗ lực tương tự trong số các đối thủ của họ. “Cách tôi nghĩ về cuộc đua lên đỉnh là không quan trọng ai thắng,” Amodei nói. “Mọi người đều thắng, phải không?”

Sự cống hiến của Amodei cho AI, được hun đúc từ bi kịch mất cha, giờ đây có thể đã có mục tiêu trong tầm mắt. AI ngày nay đã tăng tốc quá trình làm thủ tục phát triển thuốc, nó đã trở thành một cố vấn y tế (không hoàn hảo) trong một hệ thống y tế đổ vỡ, và, nếu mọi việc suôn sẻ, một ngày nào đó nó có thể thay thế cho hàng trăm hoặc hàng nghìn nhà nghiên cứu cần thiết để hiểu sinh học con người.

Liệu việc theo đuổi tầm nhìn này của Amodei, tôi hỏi, có thể làm ông mù quáng trước những rủi ro mất kiểm soát công nghệ không? “Đó không phải là cách tôi nghĩ về nó,” ông nói. “Chúng tôi đã kiểm soát các mô hình tốt hơn với mỗi mô hình mà chúng tôi phát hành. Tất cả những điều này đều có thể sai, nhưng bạn thực sự phải kiểm tra sức chịu đựng của các mô hình rất kỹ.”

Amodei xem dòng câu hỏi này bắt nguồn từ chủ nghĩa bi quan muốn làm chậm lại mà ông thường bị cáo buộc. Kế hoạch của ông, trái ngược với những người chỉ trích, là tăng tốc. “Lý do tôi cảnh báo về rủi ro là để chúng ta không phải chậm lại,” ông nói. “Tôi có một sự hiểu biết đáng kinh ngạc về những gì đang bị đe dọa. Về mặt lợi ích, về những gì nó có thể làm, những sinh mạng nó có thể cứu. Tôi đã thấy điều đó một cách cá nhân.”

Theo dõi trên X